ChatGPT Turbo – Najnowsza aktualizacja GPT-4 Turbo

Publikacja: 7 listopada 2023 | Autor: Krzysztof Pacuk

Spis treści

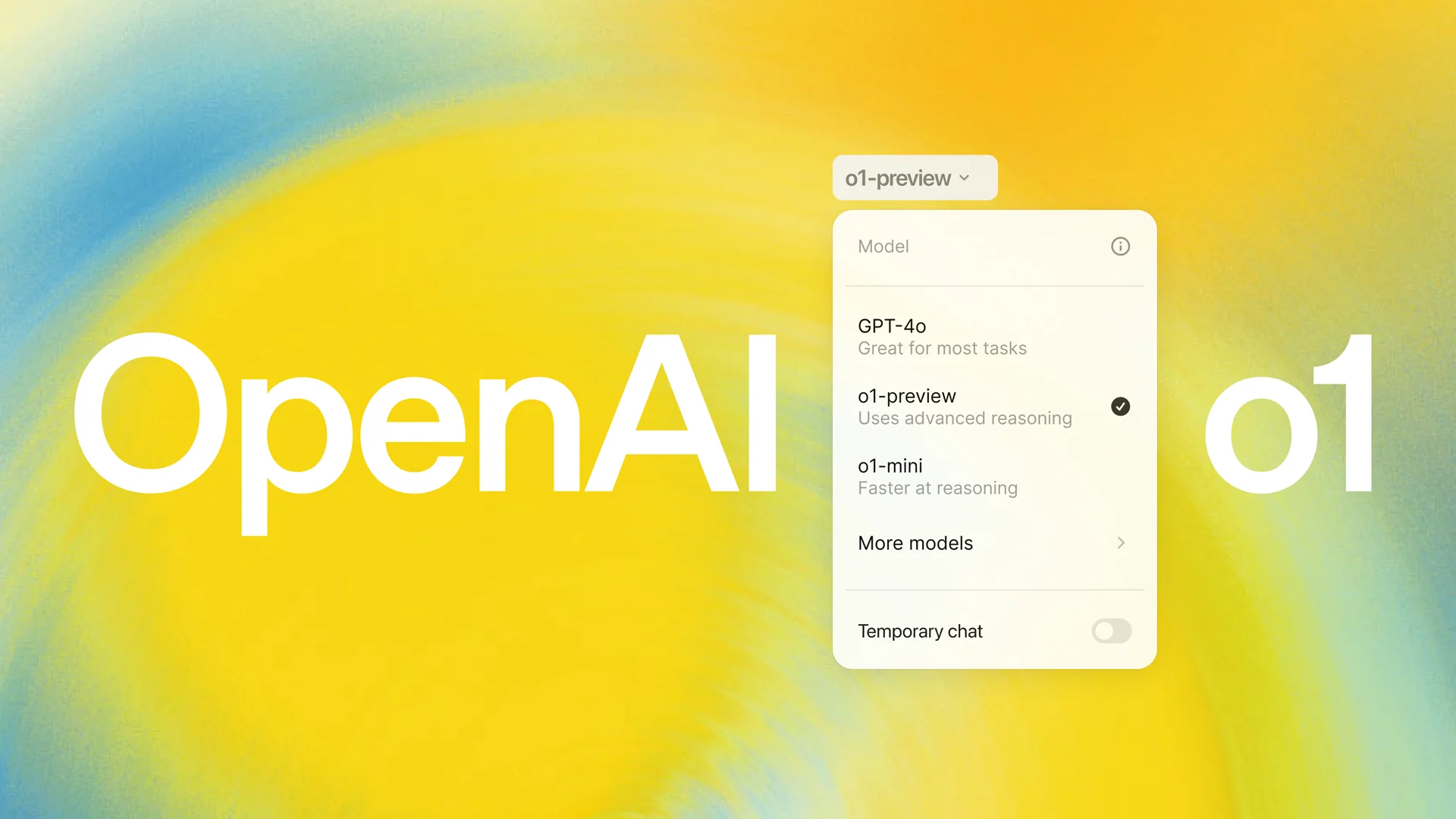

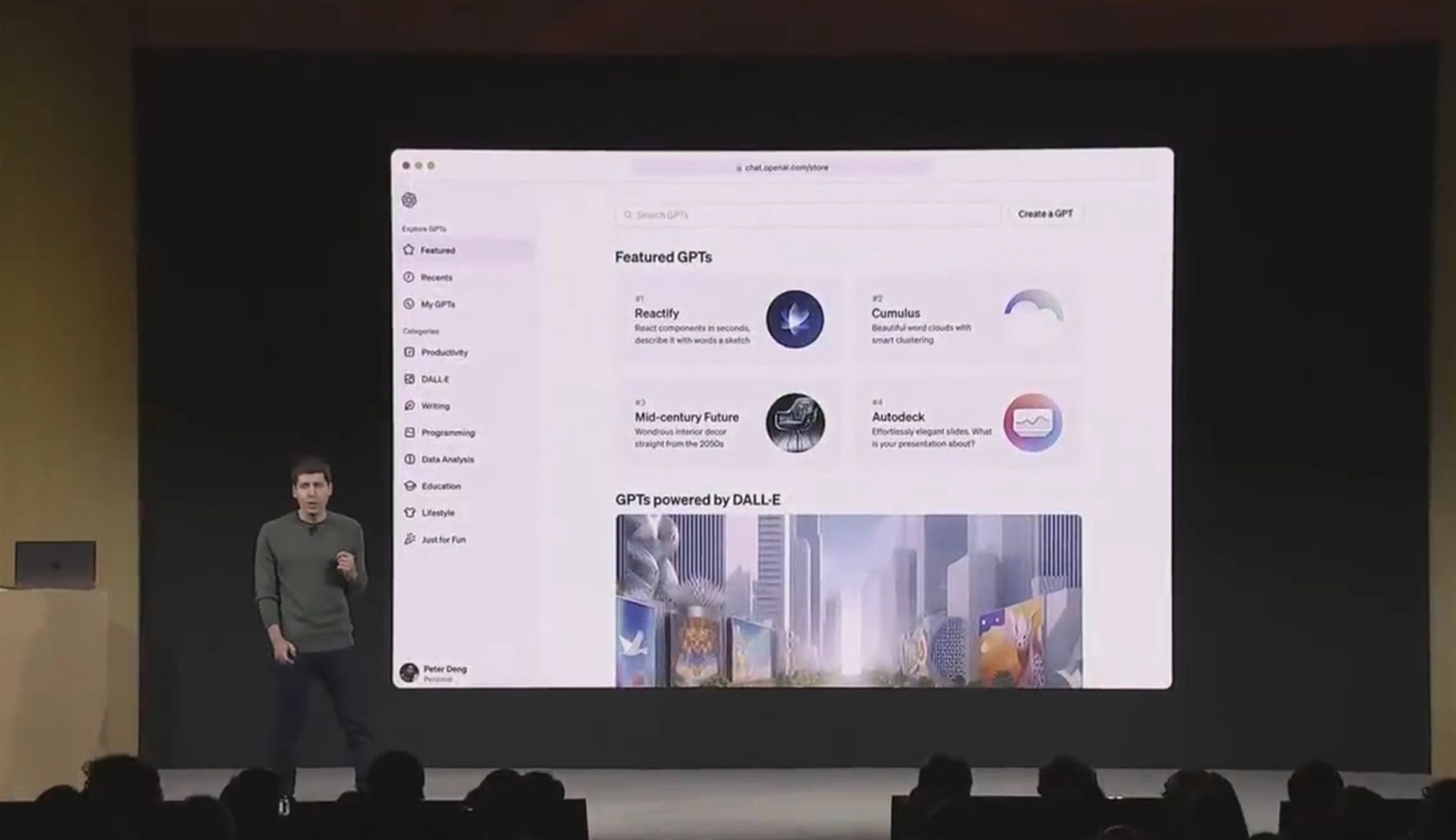

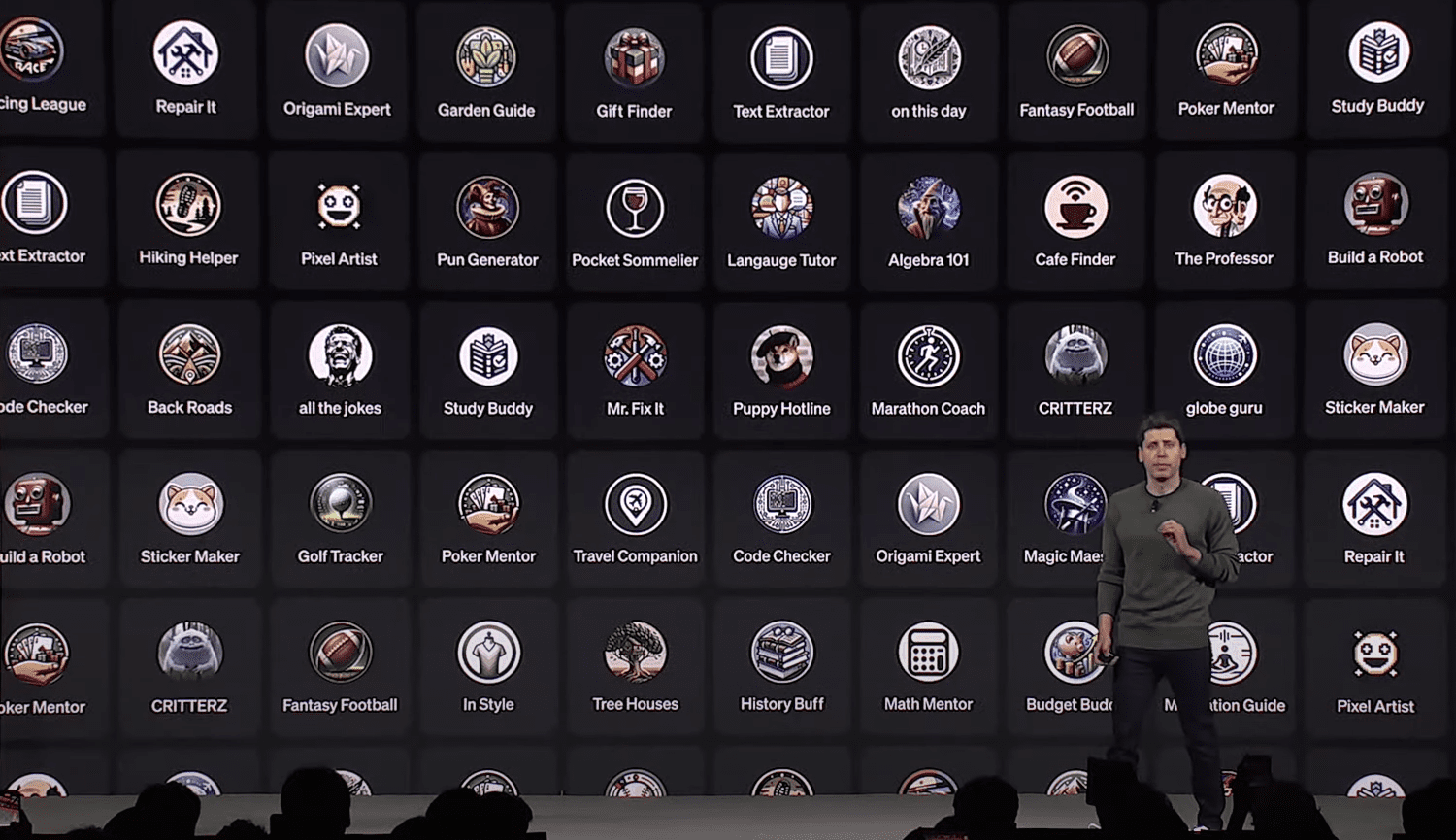

OpenAI przekracza kolejne granice innowacji, prezentując najnowszą aktualizację ChatGPT, która wprowadza model GPT Turbo – szybszy, bardziej wydajny i dostosowany do specyficznych potrzeb użytkowników.

Aktualizacja GPT-4 Turbo przynosi szereg istotnych zmian technicznych:

- Dane do kwietnia 2023 roku: Zaimplementowanie w model GPT-4 Turbo wiedzy o wydarzeniach światowych aż do kwietnia 2023 roku.

- Zwiększony kontekst: Wprowadzenie modelu GPT-4 Turbo 128K zwiększa limit tokenów do imponujących 128 000, umożliwiając generowanie dłuższych i bardziej złożonych treści bez przerywania sesji.

- Prywatny asystent: Program Custom Models otwiera drogę do stworzenia wysoce spersonalizowanych modeli AI, które mogą służyć jako prywatni asystenci, w pełni dopasowani do unikatowych potrzeb danych organizacji, bez dzielenia się nimi z innymi użytkownikami czy wykorzystywania do szkolenia innych modeli.

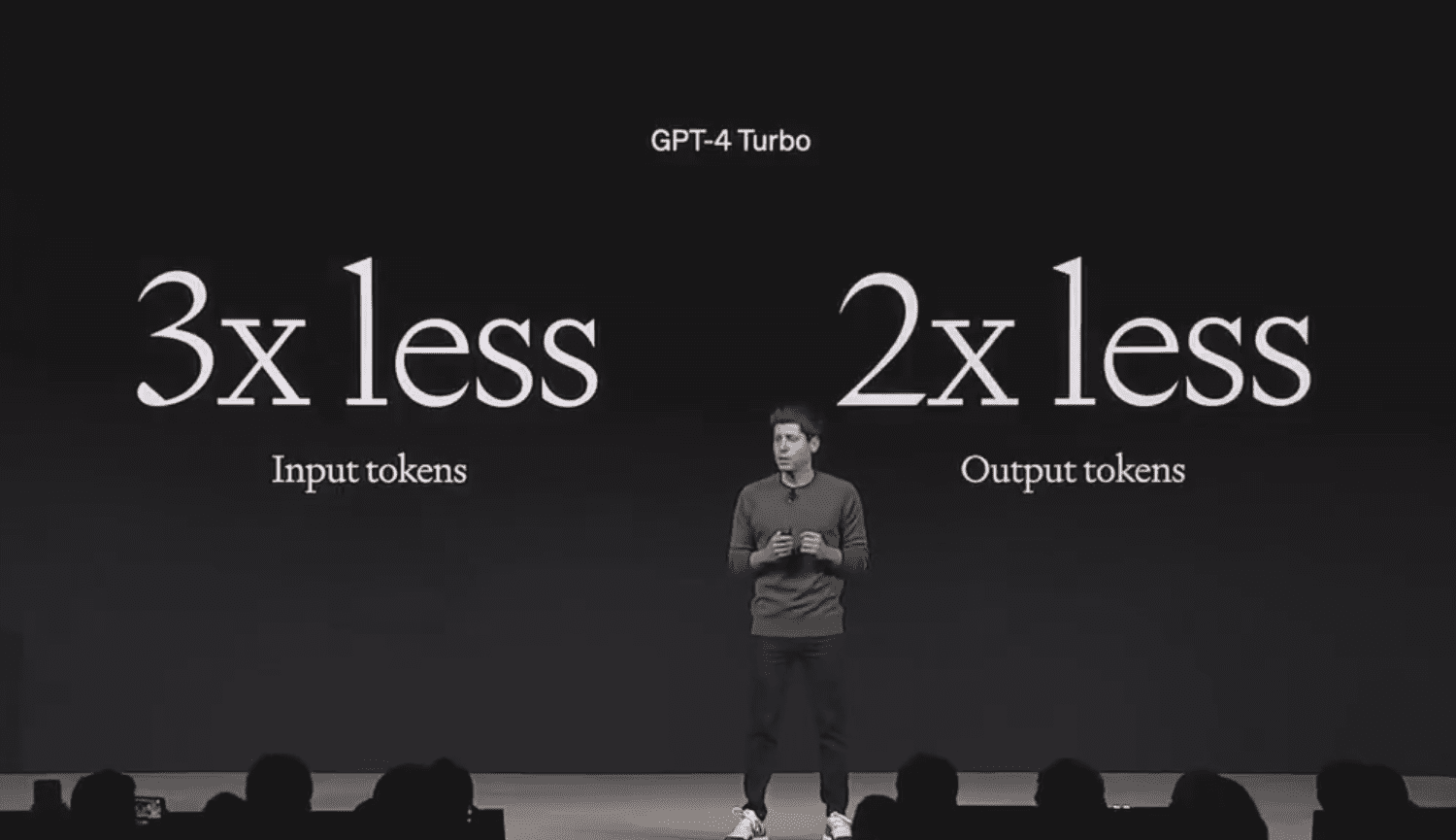

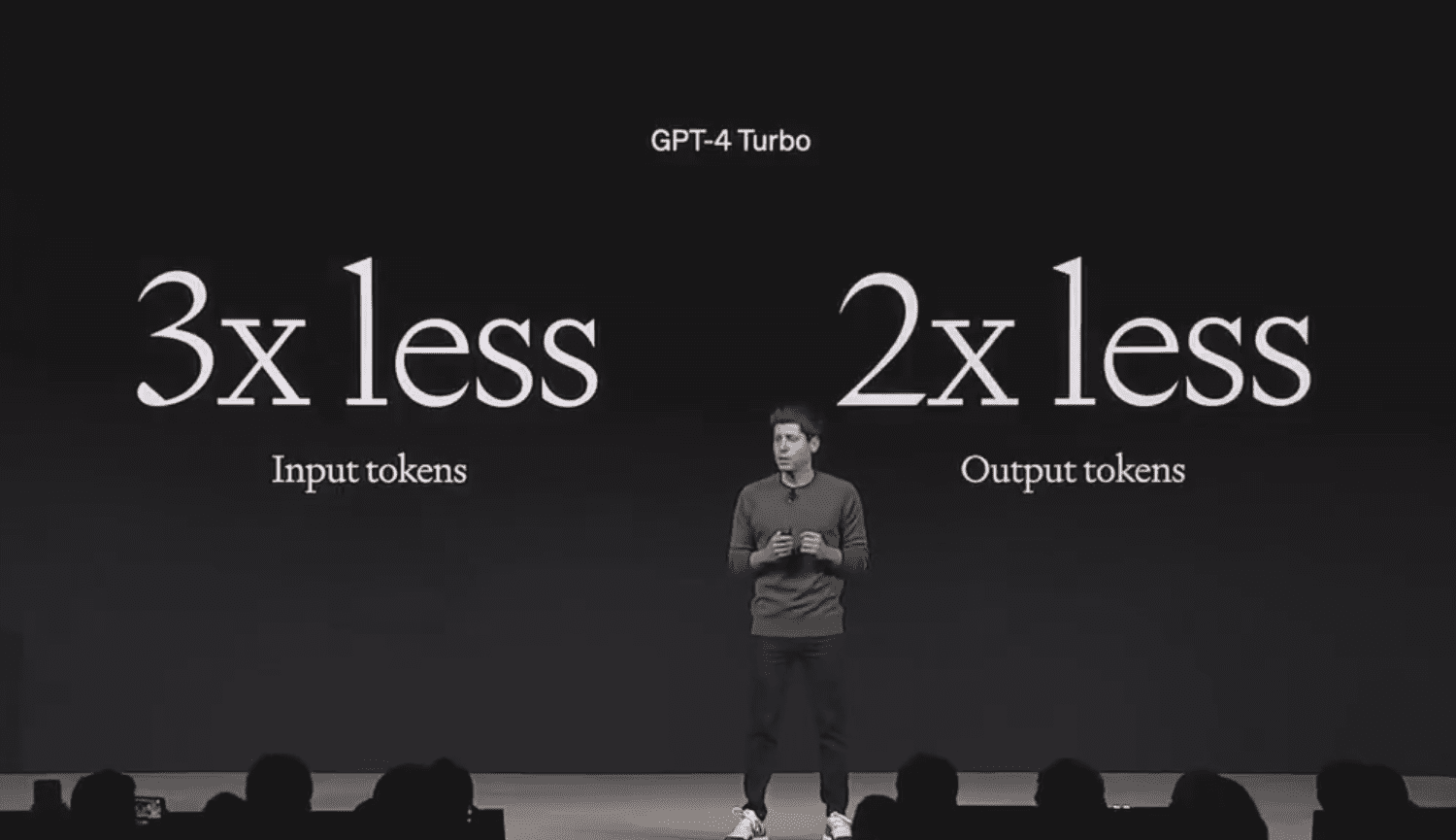

- Obniżone ceny: Ceny tokenów dla GPT-4 Turbo zostały znacząco obniżone, co sprawia, że technologia ta staje się bardziej dostępna. Wejściowe tokeny GPT-4 Turbo są teraz 3 razy tańsze, kosztując 0,01$, a tokeny wyjściowe są 2 razy tańsze, na poziomie 0,03$.

Długie teksty do 300 stron A4

Każdy bajt danych ma znaczenie, nowa aktualizacja do GPT-4 Turbo od OpenAI zmienia reguły gry, umożliwiając przetwarzanie dłuższych treści z niebywałą łatwością. Przyjmijmy to pod lupę i zastanówmy się, jak nowa zdolność modelu do obsługi 128,000 tokenów wpłynie na użytkowników i twórców aplikacji.

Tradycyjnie, modele GPT były ograniczone do stosunkowo krótkiego kontekstu tekstu – zazwyczaj rzędu kilku tysięcy tokenów, co odpowiadało mniej więcej długości jednego długiego artykułu. Wprowadzenie 128K kontekstu w GPT-4 Turbo jest odpowiednikiem przejścia z noweli do obszernej powieści. Ta zdolność pozwala na analizę i generowanie treści o długości przekraczającej 300 stron tekstu standardowej książki.

Dla użytkowników końcowych, taka skalowalność oznacza płynniejsze i głębsze rozmowy z chatbotami oraz wyższą jakość generowanych treści. A dla OpenAI, to kolejny krok w stronę realizacji wizji AI, która nie tylko rozumie i odpowiada, ale może współtworzyć i pomagać w przetwarzaniu wiedzy na niespotykaną dotąd skalę.

Własny asystent dla każdego

Asystent AI, zaimplementowany w ramach Assistants API, to niemniej niż inteligentny agent, zdolny do wykonania konkretnych zadań zgodnie z instrukcjami, korzystając przy tym z dodatkowej wiedzy oraz możliwości wywoływania modeli i narzędzi. Co ważne, Assistants API radzi sobie z wieloma skomplikowanymi zadaniami, które wcześniej spadały na barki samych programistów.

Kluczową zmianą wprowadzoną przez Assistants API jest możliwość tworzenia trwałych i potencjalnie nieskończenie długich wątków. Umożliwia to deweloperom przekazywanie zarządzania stanem wątków do OpenAI i pracę ponad ograniczeniami okna kontekstowego. Używając Assistants API, wystarczy dodawać nowe wiadomości do istniejącego wątku.

Asystenci mają dostęp do wywoływania nowych narzędzi w razie potrzeby, w tym:

- Interpreter Kodu: pisze i wykonuje kod Pythona w bezpiecznym środowisku wykonawczym, generuje wykresy i diagramy oraz przetwarza pliki z różnorodnymi danymi i formatami. Daje to możliwość iteracyjnego rozwiązywania skomplikowanych problemów programistycznych i matematycznych.

- Retrieval: rozszerza możliwości asystenta o wiedzę z zewnątrz naszych modeli, taką jak specjalistyczne dane domenowe, informacje o produkcie czy dokumenty dostarczone przez użytkowników. Oznacza to brak potrzeby obliczania i przechowywania embeddingów dla dokumentów czy implementowania algorytmów wyszukiwania i segmentacji.

- Wywoływanie Funkcji: umożliwia asystentom wywoływanie zdefiniowanych przez Ciebie funkcji i włączanie odpowiedzi funkcji do ich wiadomości.

Podobnie jak w przypadku reszty platformy, dane i pliki przekazane do API OpenAI nigdy nie są wykorzystywane do trenowania naszych modeli, a deweloperzy mogą je usunąć, gdy tylko zechcą.

Assistants API w wersji beta można wypróbować bez pisania kodu, udając się do tzw. placu zabaw dla Asystentów (Assistants playground). To właśnie tam deweloperzy mogą eksperymentować z potencjałem tej technologii, odkrywając nowe, niespotykane dotąd możliwości personalizacji i automatyzacji w swoich aplikacjach.

Niższe ceny i wyższe limity

Najnowsze ulepszenie – GPT-4 Turbo – zostało zaprojektowane, aby dostarczać treść o wysokiej jakości w niższej cenie. Weźmy pod uwagę, że tokeny wejściowe dla GPT-4 Turbo są teraz trzykrotnie tańsze niż dla poprzedniego modelu GPT-4, kosztując zaledwie 0,01$. To nie wszystko – tokeny wyjściowe są teraz dwa razy tańsze, wycenione na 0,03$. Oznacza to, że deweloperzy mogą czerpać korzyści z bardziej zaawansowanego modelu przy znacząco niższych kosztach.

Przełom jest jeszcze bardziej widoczny w przypadku GPT-3.5 Turbo. Tokeny wejściowe dla tego modelu są teraz trzykrotnie tańsze niż poprzednio, kosztując jedynie 0,001$, a tokeny wyjściowe są dwukrotnie tańsze, wycenione na 0,002$. Deweloperzy korzystający wcześniej z GPT-3.5 Turbo 4K mogą cieszyć się trzykrotną obniżką kosztów tokenów wejściowych. Te obniżki dotyczą nowo wprowadzonego modelu GPT-3.5 Turbo.

Dodatkowo, ceny za tokeny wejściowe w modelu fine-tuning GPT-3.5 Turbo 4K zostały obniżone czterokrotnie, osiągając poziom 0,003$, podczas gdy tokeny wyjściowe są tańsze o 2.7 raza, kosztując 0,006$. Co ważne, fine-tuning teraz wspiera kontekst 16K w tej samej cenie, co dla kontekstu 4K z nowym modelem GPT-3.5 Turbo. Te nowe ceny dotyczą również modeli fine-tuned gpt-3.5-turbo-0613.

Spójrzmy na kontrast pomiędzy starszymi a nowymi modelami:

- GPT-4 Turbo: Wejście spada z 0,03$ do 0,01$, a wyjście z 0,06$ do 0,03$.

- GPT-3.5 Turbo: Wejście spada z 0,003$ do 0,001$, a wyjście z 0,004$ do 0,002$ dla modelu 16K.

- GPT-3.5 Turbo fine-tuning: Wejście spada z 0,012$ do 0,003$, a wyjście z 0,016$ do 0,006$.

Takie obniżki cen, w połączeniu z podwyższonymi limitami tokenów na minutę dla płatnych użytkowników GPT-4, sygnalizują dążenie OpenAI do demokratyzacji dostępu do sztucznej inteligencji. Zapewniają one, że najnowsze narzędzia AI stają się coraz bardziej dostępne dla twórców i innowatorów, bez względu na wielkość ich projektów czy budżetów.

Technologia rozpoznawania mowy i grafika - Whisper v3 i Consistency Decoder

Model Whisper large-v3, najnowsza iteracja otwartoźródłowego modelu rozpoznawania mowy OpenAI, uosabia przyszłość technologii ASR. Wzbogacony o zaawansowane algorytmy i większą bazę danych, Whisper large-v3 ma potencjał do zmniejszenia błędów w transkrypcji i oferowania lepszej rozpoznawalności różnorodnych akcentów i dialektów, co czyni go potężnym narzędziem w globalnym kontekście. Planowane wdrożenie wsparcia dla Whisper v3 w API OpenAI to wiadomość, która z pewnością wzbudzi zainteresowanie deweloperów aplikacji wykorzystujących technologie ASR, od systemów asystujących po zaawansowane interfejsy użytkownika.

Consistency Decoder, nowe oprogramowanie od twórców Stable Diffusion, stanowi ważny krok naprzód w generowaniu grafik AI. Jest to odpowiedź na potrzebę większej spójności i dokładności w generowaniu obrazów, szczególnie tych zawierających złożone elementy, takie jak tekst, twarze czy dokładne linie. Open sourcing tego narzędzia, stanowi znaczące wsparcie dla społeczności artystycznej i programistów, umożliwiając tworzenie bardziej złożonych i wiarygodnych obrazów cyfrowych.

OpenAI wprowadziło znaczącą aktualizację swojego modelu lingwistycznego, GPT-4 Turbo, która przynosi szereg innowacji i ulepszeń. Nowa wersja pozwala na przetwarzanie dłuższych tekstów, oferuje możliwość tworzenia spersonalizowanych asystentów AI, a także dostarcza obniżone ceny zarówno dla tokenów wejściowych, jak i wyjściowych, co sprawia, że zaawansowane technologie AI stają się dostępne szerszemu gronu użytkowników. Wprowadzenie Assistants API umożliwia tworzenie długotrwałych wątków komunikacyjnych, a integracja z narzędziami takimi jak Interpreter Kodu, Retrieval i Wywoływanie Funkcji, zwiększa funkcjonalność asystentów. Dodatkowo, najnowsze ulepszenia w technologii rozpoznawania mowy, reprezentowane przez Whisper v3, oraz w grafice, dzięki Consistency Decoder, otwierają nowe perspektywy dla programistów i twórców. Aktualizacja ta sygnalizuje dążenie OpenAI do demokratyzacji sztucznej inteligencji oraz do wyznaczania nowych standardów w interaktywnej i twórczej współpracy między człowiekiem a maszyną.

Najnowsze prompty

Zobacz także